Modèle de politique d'utilisation acceptable de l'IA (AUP)

Beaucoup d'équipes adoptent des outils d'IA avant d'avoir des règles claires sur les données confidentielles, les outils approuvés, la sécurité, le contrôle qualité et la maîtrise des coûts. Cette page met à votre disposition une politique d'utilisation acceptable de l'IA (AUP) opérationnelle, que vous pouvez adapter en peu de temps. Avec, en prime, un guide de déploiement pour qu'elle fonctionne vraiment au quotidien.

Avertissement : ce modèle est fourni à titre informatif uniquement et ne constitue pas un avis juridique.

Ce que vous trouverez sur cette page

- Une politique d'utilisation acceptable de l'IA (AUP) d'une page que vous pouvez publier en interne dès aujourd'hui

- Une politique d'utilisation détaillée, mieux adaptée aux audits, aux évaluations fournisseurs et à l'application au quotidien

- Une checklist de mise en œuvre étape par étape (responsables, formation, approbations, signalement d'incidents)

- Des réponses claires aux questions fréquentes (comptes personnels, données sensibles, fréquence de révision)

Qu'est-ce qu'une politique d'utilisation acceptable de l'IA (AUP) ?

Une politique d'utilisation acceptable de l'IA est un ensemble de règles du quotidien qui définit ce que les collaborateurs peuvent et ne peuvent pas faire avec les outils d'IA au travail. Les AUP couvrent généralement les points suivants :

- Quels outils d'IA sont approuvés (et comment y accéder, par exemple via des comptes d'entreprise/SSO)

- Quelles données peuvent être saisies (informations publiques, données confidentielles, données personnelles clients)

- Comment les résultats doivent être contrôlés (vérification de l'exactitude, sources, validation humaine pour les usages sensibles)

- Comment signaler les incidents (fuite de données présumée, violations de la politique, prompt injection)

Une « politique IA » peut être plus large (gouvernance, éthique, rôles). Une politique d'utilisation de l'IA est le sous-ensemble pratique qui encadre l'usage au quotidien.

Quand avez-vous besoin d'une politique d'utilisation de l'IA ?

Vous devriez envisager de publier une politique d'utilisation de l'IA si l'un des points suivants s'applique :

- Vos collaborateurs utilisent l'IA pour rédiger, résumer, faire des recherches ou coder

- Des personnes collent des documents internes, des e-mails clients, des contrats ou des comptes rendus de réunion

- Votre équipe produit des contenus générés par IA pour le marketing, les ventes ou le support client

- Vous voulez de la visibilité sur l'usage et les coûts (et éviter les comptes « shadow IA »)

Comment utiliser ce modèle (5 minutes)

- Remplacez tous les espaces réservés entre crochets comme

[Nom de l'entreprise]. - Supprimez les sections dont vous n'avez pas besoin

- Faites-la relire par la Sécurité/IT, le Juridique, les RH et un référent métier

- Publiez-la en interne et intégrez-la au parcours d'onboarding.

Comment mettre en œuvre votre politique d'utilisation de l'IA (pour qu'elle fonctionne vraiment)

Copier une politique est facile. La déployer et la maintenir à jour, c'est ce qui évite les problèmes ensuite. Voici un processus pragmatique qui fonctionne pour les équipes mixtes (Sécurité/IT, Juridique, RH, Finance, Operations, Produit, Marketing).

Étape 1 : désigner un responsable et un circuit d'approbation

- Nommez un responsable de la politique (souvent Sécurité/IT).

- Définissez qui doit approuver les exceptions (souvent Juridique/Sécurité pour les données sensibles).

- Mettez en place un point de contact unique pour les questions des collaborateurs (par exemple

#ai-helpou une boîte mail partagée).

Pourquoi c'est important : si les gens ne savent pas à qui s'adresser, ils devinent ou contournent la politique.

Étape 2 : maintenir une liste des « outils d'IA approuvés »

Décidez :

- Quels outils sont autorisés pour le travail

- Si le SSO/comptes d'entreprise est obligatoire

- Quels modèles/fonctionnalités sont restreints (par exemple les modèles plus coûteux, plug-ins/extensions)

Astuce : gardez la liste des outils approuvés à côté de la politique pour qu'elles ne dérivent pas l'une de l'autre.

Étape 3 : définir des règles de données que les gens peuvent retenir

La plupart des manquements à la politique surviennent parce que les collaborateurs ne savent pas exactement ce qu'ils peuvent coller dans un outil d'IA.

Utilisez trois catégories :

- Jamais autorisé (secrets, identifiants, données de paiement)

- Autorisé uniquement avec approbation (données personnelles clients, contrats non publics, détails de sécurité)

- Généralement autorisé (informations publiques, textes anonymisés, brouillons génériques)

Étape 4 : fixer des règles pour les résultats et le contrôle qualité

Indiquez clairement que les résultats de l'IA sont un brouillon tant qu'ils n'ont pas été vérifiés. Définissez quand vous exigez :

- Une relecture humaine

- Des sources/références

- Une validation par une seconde personne (par exemple le Juridique pour les déclarations externes)

Étape 5 : former brièvement et répéter

Une formation de 15 minutes suffit généralement si elle inclut :

- 3 exemples de « collage OK »

- 3 exemples de « à ne jamais coller »

- Que faire en cas de doute (canal d'aide + escalade)

Étape 6 : mettre en place le signalement d'incidents et la supervision

Définissez :

- Qui est notifié en cas de fuite de données présumée ou de violation de la politique

- Quelles informations doivent figurer dans un signalement (outil utilisé, type de données, horodatage, utilisateur, captures d'écran/logs)

Étape 7 : réviser la politique selon un calendrier

Fixez une fréquence (souvent trimestrielle) et mettez-la à jour quand :

- De nouveaux outils/modèles sont introduits

- Les tarifs ou les conditions des fournisseurs changent

- La réglementation ou les exigences clients évoluent

Erreurs fréquentes (et comment les éviter)

- Rédiger une politique trop stricte, et les gens l'ignorent

Solution : des réglages par défaut sûrs et un processus d'approbation clair. - Autoriser des comptes IA personnels pour le travail, et la visibilité comme le contrôle baissent, avec des incohérences à la clé

Solution : utilisez des comptes gérés par l'entreprise/SSO dès que possible. - Pas de liste d'outils approuvés, et la « politique » devient inapplicable

Solution : maintenez une liste suivie avec un responsable. - Pas de responsable / pas de date de révision, et la politique se périme

Solution : désignez un responsable et fixez un calendrier de révision.

1) Politique d'utilisation de l'IA (AUP), démarrage rapide (1 page)

Politique d'utilisation de l'IA (AUP), démarrage rapide

Copiez/collez, puis remplacez tout ce qui est entre crochets comme [Nom de l'entreprise].

POLITIQUE D'UTILISATION DE L'IA (AUP), DÉMARRAGE RAPIDE Entreprise : [Nom de l'entreprise] Date d'effet : [AAAA-MM-JJ] Responsable de la politique : [Équipe / Rôle] S'applique à : tous les collaborateurs, prestataires, stagiaires et intérimaires Fréquence de révision : [Trimestrielle / Semestrielle] 1) Objet Cette politique définit l'utilisation acceptable des outils d'IA pour gagner en productivité tout en protégeant les données de l'entreprise, les clients et la propriété intellectuelle. 2) Outils d'IA approuvés Utilisez exclusivement les outils d'IA approuvés par [IT/Sécurité]. Liste des outils approuvés : [Lien / Liste]. N'utilisez pas de comptes IA personnels pour des tâches professionnelles, sauf approbation explicite. 3) Règles de données (le plus important) N'entrez JAMAIS les éléments suivants dans un outil d'IA : - Mots de passe, secrets, clés d'API, clés privées, jetons d'accès - Données de paiement (carte/banque), codes d'authentification - Données personnelles clients (PII), sauf approbation de [Juridique/Sécurité] - Contrats confidentiels, documents juridiques, informations financières non publiques, sauf approbation - Code source propriétaire ou détails d'architecture, sauf approbation Entrées autorisées (exemples) : - Informations publiquement disponibles - Texte nettoyé/anonymisé sans identifiants - Brouillons génériques sans détails confidentiels 4) Règles relatives aux résultats - Traitez les résultats d'IA comme un brouillon : vérifiez les faits, les sources, les calculs et les affirmations. - Ne publiez pas de contenus générés par IA en externe sans relecture humaine. - Ne vous appuyez pas uniquement sur l'IA comme base d'une décision juridique/médicale/financière. 5) Propriété intellectuelle (PI) N'insérez pas de contenus tiers protégés par le droit d'auteur dans les outils d'IA, sauf si cela est autorisé. Suivez [les règles de l'entreprise relatives à la PI et aux sources] pour les livrables produits avec l'aide de l'IA. 6) Sécurité et intégrations - Utilisez le SSO (authentification unique) quand il est disponible. - Ne connectez pas d'outils d'IA aux lecteurs/bases de connaissances de l'entreprise sans approbation. - Signalez sans délai toute fuite de données présumée à [Contact sécurité]. 7) Journalisation, supervision et coûts L'utilisation de l'IA peut être journalisée à des fins de sécurité, de conformité et de maîtrise des coûts. Les collaborateurs doivent respecter les limites/budgets d'usage définis par [Responsable]. 8) Manquements Les manquements peuvent entraîner un accès restreint et des mesures disciplinaires pouvant aller jusqu'au licenciement. Approbation [Nom, fonction] [Date]

2) Modèle complet de politique d'utilisation de l'IA (détaillé)

Utilisez cette version si vous voulez une politique mieux adaptée aux audits, aux évaluations fournisseurs et à l'application au quotidien.

Politique d'utilisation de l'IA (AUP)

Copiez/collez, puis remplacez tout ce qui est entre crochets comme [Nom de l'entreprise].

POLITIQUE D'UTILISATION DE L'IA (AUP) Contrôle du document - Entreprise : [Nom de l'entreprise] - Version : [1.0] - Date d'effet : [AAAA-MM-JJ] - Responsable : [Rôle / Équipe] - Approuvée par : [Rôle] - Fréquence de révision : [Trimestrielle / Semestrielle] 1. Objet 1.1 Objet [Nom de l'entreprise] (« l'Entreprise ») permet aux collaborateurs d'utiliser des outils d'intelligence artificielle (« IA ») pour gagner en productivité tout en protégeant les données de l'entreprise, les clients et la propriété intellectuelle. 1.2 Objectifs Cette politique poursuit les objectifs suivants : (a) protéger les données de l'entreprise, des clients et des partenaires, (b) réduire les risques juridiques et de conformité, (c) garantir des résultats de qualité et un usage responsable, (d) gérer et maîtriser les coûts. 2. Périmètre 2.1 Personnes concernées Cette politique s'applique à tous les collaborateurs, prestataires, stagiaires et intérimaires. 2.2 Systèmes et données concernés Cette politique couvre tout usage de l'IA en lien avec les systèmes, comptes, réseaux ou données de l'entreprise, y compris les outils d'IA tiers utilisés pour des tâches professionnelles. 3. Définitions 3.1 Outil d'IA Tout système qui, à l'aide de l'apprentissage automatique, génère ou transforme du texte, des images, de l'audio, de la vidéo ou du code. 3.2 Données confidentielles Toutes les informations non publiques concernant l'entreprise, ses clients, partenaires ou collaborateurs, y compris les informations commerciales, financières, juridiques, techniques ou de sécurité. 3.3 Données personnelles (PII) Informations permettant d'identifier une personne directement ou indirectement (par ex. nom, e-mail, téléphone, numéro de pièce d'identité). 4. Principes 4.1 Responsabilité humaine La responsabilité des décisions et des livrables reste humaine. L'IA ne remplace pas le jugement professionnel. 4.2 Moindre privilège Les outils et intégrations d'IA reçoivent uniquement l'accès minimum nécessaire. 4.3 Minimisation des données Ne fournissez que les données strictement nécessaires à la tâche. 4.4 Sécurité dès l'origine Utilisez des outils approuvés et des configurations sûres (SSO, chiffrement, contrôles d'accès). 5. Outils et comptes approuvés 5.1 Liste des outils approuvés Les collaborateurs ne doivent utiliser que les outils approuvés par [IT/Sécurité] et listés au lien suivant : [Lien]. 5.2 Exigences pour les comptes - Utilisez des comptes gérés par l'entreprise (SSO) là où ils sont disponibles. - N'utilisez pas de comptes IA personnels pour des tâches professionnelles sans approbation de [IT/Sécurité]. 5.3 Demandes d'outils Les demandes pour de nouveaux outils d'IA doivent être soumises via [Processus/Lien] et sont évaluées sur : - les contrôles de sécurité (SSO, RBAC, chiffrement) - les politiques de traitement et de conservation des données - la conformité (DPA, SOC 2 ou équivalent) - l'impact sur les coûts 6. Règles relatives aux données 6.1 Entrées interdites (jamais autorisées) Les collaborateurs ne doivent jamais saisir les éléments suivants dans un outil d'IA : - mots de passe, identifiants, secrets, jetons d'accès, clés privées - données de carte de crédit ou de compte bancaire - codes d'authentification (OTP), codes de récupération - données personnelles hautement sensibles (santé, biométrie, etc.) 6.2 Entrées restreintes (uniquement avec approbation) Les éléments suivants ne peuvent être utilisés qu'avec une approbation documentée de [Juridique/Sécurité] et avec des protections appropriées : - données personnelles clients ou contenus clients - documents juridiques non publics, contrats ou négociations - résultats financiers non publics ou prévisions - code propriétaire, architecture système ou détails de sécurité 6.3 Entrées autorisées Les entrées suivantes sont en principe autorisées : - informations publiquement disponibles - texte nettoyé/anonymisé qui ne permet pas d'identifier une personne ou un client - brouillons génériques sans détails commerciaux confidentiels 6.4 Exigences d'anonymisation Lorsqu'ils utilisent des textes internes, les collaborateurs doivent retirer ou masquer : - noms, adresses e-mail, numéros de téléphone, adresses postales - identifiants clients et numéros de compte - noms de projet uniques ou identifiants confidentiels 6.5 Stockage et conservation Les collaborateurs doivent partir du principe que les contenus saisis dans des outils d'IA tiers peuvent être stockés et consultés par le fournisseur, sauf accord écrit stipulant le contraire. 7. Utilisation des résultats et contrôles qualité 7.1 Vérification Les résultats d'IA doivent être vérifiés sur : - l'exactitude factuelle - les sources/preuves à l'appui des affirmations - les calculs et le raisonnement - la conformité aux standards de l'entreprise 7.2 Publication externe Les contenus générés par IA (marketing, documentation, code, communication client, etc.) ne doivent pas être publiés en externe sans relecture humaine. 7.3 Décisions sensibles L'IA ne doit pas être la seule base d'une décision juridique, médicale, RH, de conformité, de recrutement ou financière. 8. Propriété intellectuelle et licences 8.1 Contenus tiers Les collaborateurs ne peuvent saisir des contenus tiers protégés par le droit d'auteur que si une licence ou une autorisation expresse le permet. 8.2 PI de l'entreprise Les livrables produits avec l'aide de l'IA sont des livrables de l'entreprise et doivent respecter [la politique PI]. Lorsque nécessaire, des sources doivent être citées et des traces des origines conservées. 9. Sécurité et intégrations 9.1 Intégrations avec les systèmes internes La connexion d'outils d'IA aux systèmes de l'entreprise (Google Drive, Notion, Confluence, bases de données, ticketing, etc.) nécessite l'approbation de [IT/Sécurité]. 9.2 Contrôles d'accès pris en charge : - contrôle d'accès basé sur les rôles (RBAC) - gestion des utilisateurs (idéalement via SSO) - journaux d'audit (si disponibles) 9.3 Signalement d'incidents Les collaborateurs doivent signaler sans délai à [Contact sécurité] toute fuite de données présumée, incident de prompt injection ou violation de la politique. 10. Protection des données et conformité 10.1 Conformité juridique L'utilisation de l'IA doit respecter les lois applicables et les politiques de l'entreprise (protection des données, sécurité, conservation, RH, etc.). 10.2 Restrictions clients et partenaires Si un contrat client limite l'utilisation de l'IA, ces restrictions priment sur la présente politique. 11. Maîtrise des coûts et suivi de l'utilisation 11.1 Budgétisation [Responsable] définit des budgets et/ou des limites d'utilisation par équipe/rôle. 11.2 Supervision L'utilisation de l'IA peut être supervisée et reportée à des fins de sécurité, de conformité et de maîtrise des coûts. 11.3 Restrictions de modèles Le cas échéant, les modèles plus coûteux peuvent être restreints à certains rôles ou cas d'usage. 12. Formation et support 12.1 Formation Les collaborateurs doivent suivre la formation IA requise avant d'utiliser les outils d'IA approuvés pour des tâches professionnelles. 12.2 Support Les questions doivent être adressées à : - Sécurité/IT : [Contact] - Juridique : [Contact] - RH/People Ops : [Contact]

FAQ (politique d'utilisation de l'IA)

Est-ce la même chose qu'un « modèle de politique IA » ?

Une politique IA est plus large (gouvernance, éthique, conformité, rôles). Une politique d'utilisation est le sous-ensemble pratique qui définit ce que les collaborateurs peuvent et ne peuvent pas faire au quotidien.

Les collaborateurs peuvent-ils utiliser des comptes IA personnels pour le travail ?

En principe non, sauf approbation explicite. Les comptes personnels réduisent la visibilité, le contrôle et la cohérence.

Qui devrait être responsable de cette politique ?

En général la Sécurité/IT, avec la contribution du Juridique, des RH et d'un référent métier (par ex. Operations/Finance).

À quelle fréquence devons-nous la mettre à jour ?

Au minimum tous les trimestres, tant que les outils, les tarifs et la réglementation évoluent.

Peut-on coller des documents internes dans un outil d'IA ?

Uniquement si :

- l'outil est approuvé, et

- le document ne contient pas de données restreintes (ou que vous disposez d'une approbation), et

- vous respectez les règles d'anonymisation/caviardage de votre entreprise.

Dans le doute, traitez les documents internes comme restreints tant que ce n'est pas tranché.

Peut-on utiliser l'IA pour rédiger des messages clients ?

En règle générale oui, avec des garde-fous :

- traitez-les uniquement comme un brouillon jusqu'à relecture,

- évitez les données clients sensibles dans les prompts,

- assurez-vous que les affirmations sont exactes et conformes à la politique.

Devons-nous exiger des sources ou des preuves ?

Pour tout ce qui concerne des affirmations factuelles, de la recherche ou des sujets liés à la conformité, exiger des sources/preuves réduit le risque et améliore la qualité.

Faut-il des règles différentes pour des équipes différentes ?

La plupart des entreprises s'en sortent mieux avec une seule politique d'utilisation de l'IA de base, plus des compléments optionnels (par exemple des règles plus strictes pour le support, les ventes, l'ingénierie, les RH).

Et pour l'utilisation de l'IA dans les décisions de recrutement, juridiques, médicales ou financières ?

N'utilisez pas l'IA comme seule base de décisions sensibles. Si l'IA est utilisée, une responsabilité humaine, une documentation et une relecture appropriée sont requises.

Vous voulez rendre votre politique d'utilisation de l'IA plus facile à suivre en pratique ?

Rédiger une politique est la première étape. Le plus dur, c'est de garder vos outils approuvés, vos connaissances internes et l'usage de l'équipe au même endroit, pour que les gens ne se rabattent pas sur des comptes personnels ou des workflows ad hoc.

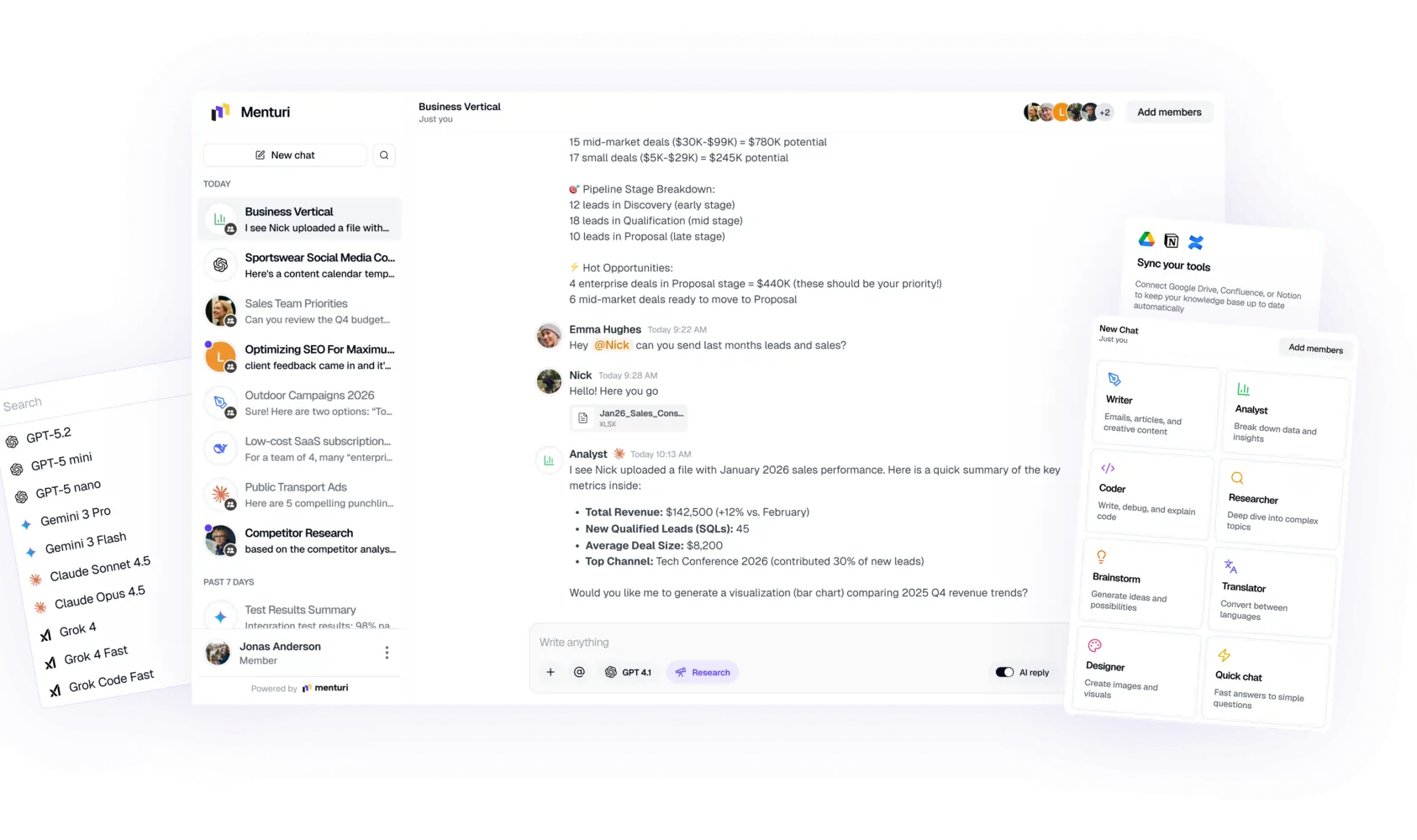

Menturi est conçu pour les équipes qui veulent un espace de travail IA unique avec :

- chats partagés + privés (collaboration façon Slack/Teams)

- connexions aux bases de connaissances (Google Drive, Notion, Confluence)

- suivi de l'usage et des coûts (par collaborateur + exports)

- contrôles d'équipe comme le SSO et la restriction des modèles coûteux

Créez un espace de travail, invitez un coéquipier et testez Menturi en quelques minutes sur une tâche réelle (rédaction, analyse ou deep research).